GPT-4oとは

2024年5月14日発表されたChatGPTの最新モデルが「GPT-4o」となります。

詳細はOpenAIのリンクをご覧下さい。

リンク先の「Try on ChatGPT」よりお試しが可能です。

https://openai.com/index/hello-gpt-4o

GPT-4oの主な特徴

- 高速なトークン生成: GPT-4oは、GPT-4 Turboよりもトークンの生成速度が2倍高速です。これにより、より迅速な応答が求められるアプリケーションでの利用が可能です。

- 高いレート制限: GPT-4oには、GPT-4 Turboの5倍のレート制限があり、1分あたり最大1,000万トークンに対応しています。これは使用量が多い開発者にとって非常に有用で、今後数週間でこのレベルまで引き上げる予定です。

- 視覚機能の向上: GPT-4oは、ほとんどのタスクにおいて視覚機能が向上しています。特に、ビデオ(音声なし)の理解をサポートしており、フレーム(1秒あたり2~4フレーム)に変換することでビデオをモデルに入力できます。

- APIの拡張機能: GPT-4oのAPIは、ビジョン機能を使用してビデオコンテンツを入力する方法をサポートしています。具体的には、均一にサンプリングされたフレームまたはキーフレーム選択アルゴリズムを使用してビデオをフレームに変換します。

りょう

りょう文章作成がこれまでより格段に速い!

制限事項と今後の予定

- オーディオのサポート: 現時点で、GPT-4oのAPIはオーディオをサポートしていません。しかし、今後数週間以内に信頼できるテスターにこのモダリティを提供する予定です。

- 画像生成のサポート: GPT-4oのAPIはまだ画像の生成をサポートしていません。画像生成が必要な場合は、引き続きDALL-E 3 APIを利用することをお勧めします。

APIでもオーディオや画像生成が使えるようになる予定だよ

GPT-4oの特長

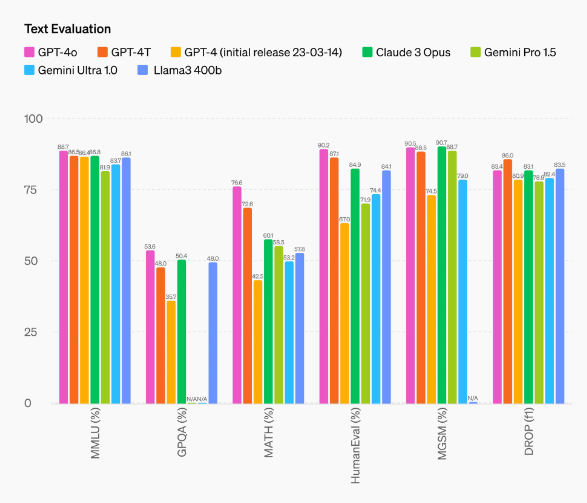

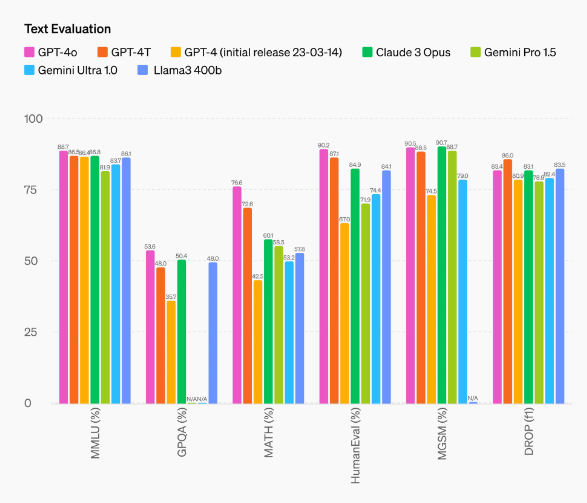

高い知能

GPT-4oは、テキスト、推論、コーディングインテリジェンスに関してGPT-4 Turboと同等のパフォーマンスを実現しながら、多言語、オーディオ、ビジョン機能において新たな最高水準を設定しています。詳細な評価結果は、オープンソースのSimple-Evals GitHubリポジトリで確認できます。

MMLU (一般知識の質問) で 88.7% という新たな高スコアを記録したんだって。

参考:公式サイト

ChatGPTより2倍高速

GPT-4oは、GPT-4 Turboよりもトークン生成が2倍高速です。これにより、より迅速な応答が可能となります。

価格設定は50%減を実現

GPT-4oは、入力トークン(100万あたり5ドル)と出力トークン(100万あたり15ドル)でGPT-4 Turboより50%安価です。コストパフォーマンスに優れた選択肢となります。

5倍高いレート制限

GPT-4oには、GPT-4 Turboの5倍のレート制限があり、1分あたり最大1,000万トークンに対応しています。使用量が多い開発者にとって非常に魅力的です。

視覚機能の改善

GPT-4oは、ほとんどのタスクにおいて視覚機能が向上しており、ビデオの理解をサポートします。ビデオをモデルに入力するためには、フレーム(1秒あたり2~4フレーム、均一にサンプリングまたはキーフレーム選択アルゴリズムを使用)に変換する必要があります。

多言語機能の向上

GPT-4oは英語以外の言語での機能が向上しており、新しいトークナイザーにより英語以外のテキストも効率的にトークン化できます。これにより、さまざまな言語での利用がさらに便利になりました。

拡張されたコンテキストウィンドウ

GPT-4oには128Kのコンテキストウィンドウがあり、ナレッジカットオフ日は2023年10月です。これにより、広範な文脈を保持したまま高精度な応答を生成できます。

モダリティのサポート

ビジョン機能

GPT-4oのAPIはビジョン機能によるビデオ(音声なし)の理解をサポートしています。ビデオをフレームに変換し、モデルに入力することで、ビデオコンテンツの理解が可能です。詳細はGPT-4oクックブックを参照してください。

オーディオサポート

現在、GPT-4oのAPIはオーディオをサポートしていませんが、今後数週間以内に信頼できるテスターに提供する予定です。

画像生成

GPT-4oのAPIはまだ画像の生成をサポートしていません。画像生成が必要な場合は、引き続きDALL-E 3 APIを利用することをお勧めします。

モデルの機能と評価

GPT-4oは、人間とコンピューターの自然な対話を目指して設計されています。テキスト、音声、画像のあらゆる組み合わせを入力として受け入れ、あらゆる組み合わせの出力を生成します。音声入力には平均320ミリ秒で応答し、英語のテキストやコードにおいても高いパフォーマンスを発揮します。

モデルの評価

GPT-4oは、従来のベンチマークにおいても優れたパフォーマンスを示しています。特に、視覚と音声の理解において他のモデルを上回ります。

言語のトークン化

新しいトークナイザーにより、多くの言語で効率的にトークン化が行われます。これにより、グローバルなユーザーにとっても使いやすいモデルとなっています。

モデルの安全性

GPT-4oには、トレーニングデータのフィルタリングやモデルの動作調整などの安全性対策が組み込まれています。外部の専門家と連携し、モデルの安全性を確保しています。

GPT-4oの利用方法

開発者向け

開発者は、APIを通じてGPT-4oにアクセスできます。GPT-4 Turboと比較して2倍高速で、価格は半分、レート制限は5倍高くなっています。今後数週間以内に、信頼できるパートナーに対して新しいオーディオおよびビデオ機能のサポートを開始する予定です。

ユーザー向け

GPT-4oのテキストおよび画像機能は、ChatGPTで利用可能です。無料枠やPlusユーザーも利用でき、最大5倍のメッセージ制限があります。今後、ChatGPT Plus内でアルファ版の音声モードも公開予定です。

まとめ

GPT-4oは、ディープラーニングの限界を押し上げるための最新のステップであり、実用的な使いやすさに重点を置いています。さまざまなモダリティに対応し、多言語サポートや高速な応答が可能です。

APIにもイラストや音声機能が搭載される予定もあり、これからも目が離せないですね。

とは何?代表的な種類は?仕組みや実現できることは?-300x157.jpg)

コメント